James Demmel 教授 (加州大学伯克利分校): Colossal-AI 让分布式训练高效、易用、可扩展。

James Demmel 教授 (加州大学伯克利分校): Colossal-AI 让分布式训练高效、易用、可扩展。

(返回顶端)

## 特点 Colossal-AI 为您提供了一系列并行组件。我们的目标是让您的分布式 AI 模型像构建普通的单 GPU 模型一样简单。我们提供的友好工具可以让您在几行代码内快速开始分布式训练和推理。 - 并行化策略 - 数据并行 - 流水线并行 - 1维, [2维](https://arxiv.org/abs/2104.05343), [2.5维](https://arxiv.org/abs/2105.14500), [3维](https://arxiv.org/abs/2105.14450) 张量并行 - [序列并行](https://arxiv.org/abs/2105.13120) - [零冗余优化器 (ZeRO)](https://arxiv.org/abs/1910.02054) - 异构内存管理 - [PatrickStar](https://arxiv.org/abs/2108.05818) - 使用友好 - 基于参数文件的并行化 - 推理 - [Energon-AI](https://github.com/hpcaitech/EnergonAI)(返回顶端)

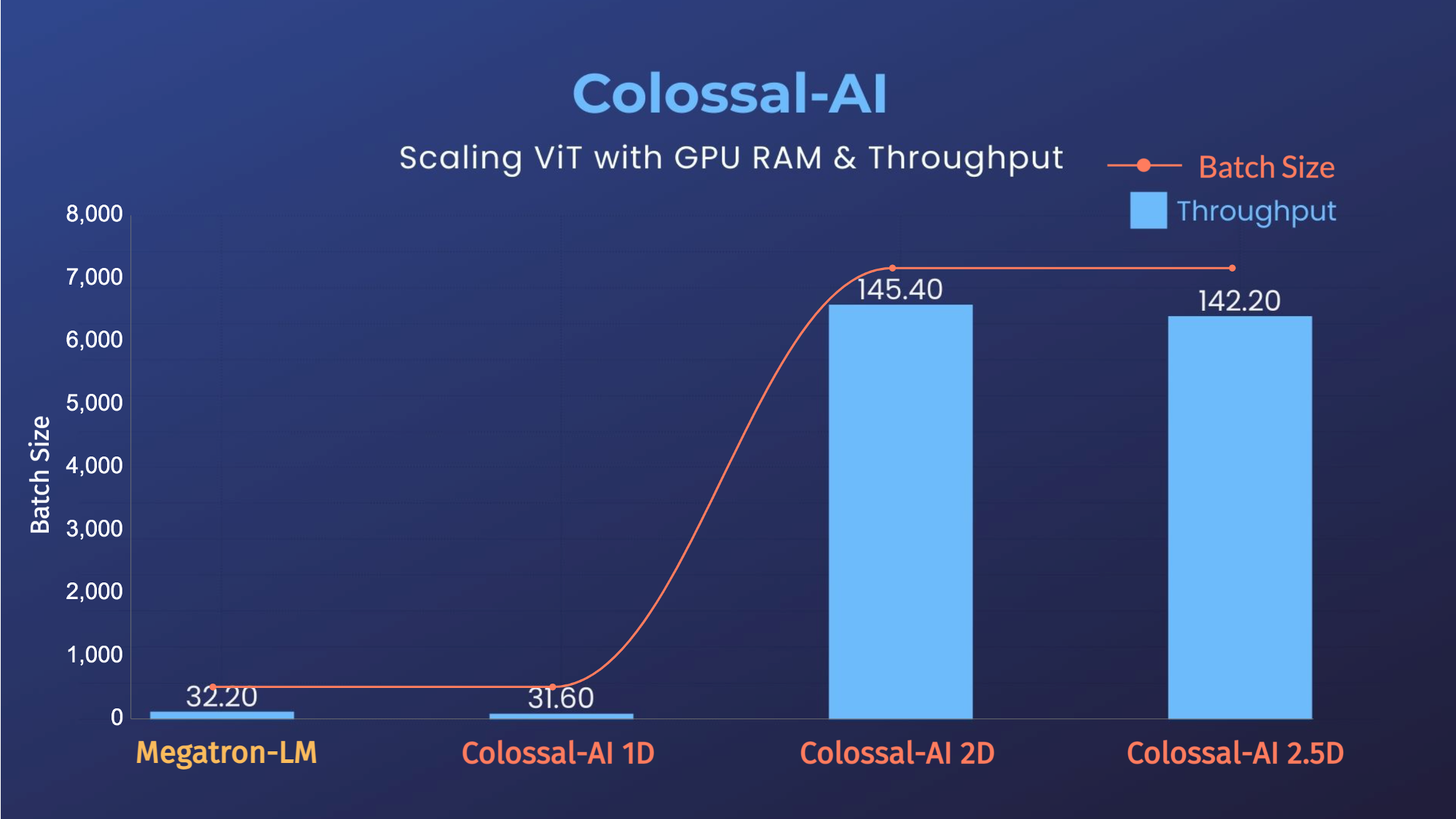

## 并行训练样例展示 ### ViT

- 降低11倍 GPU 显存占用,或超线性扩展(张量并行)

- 降低11倍 GPU 显存占用,或超线性扩展(张量并行)

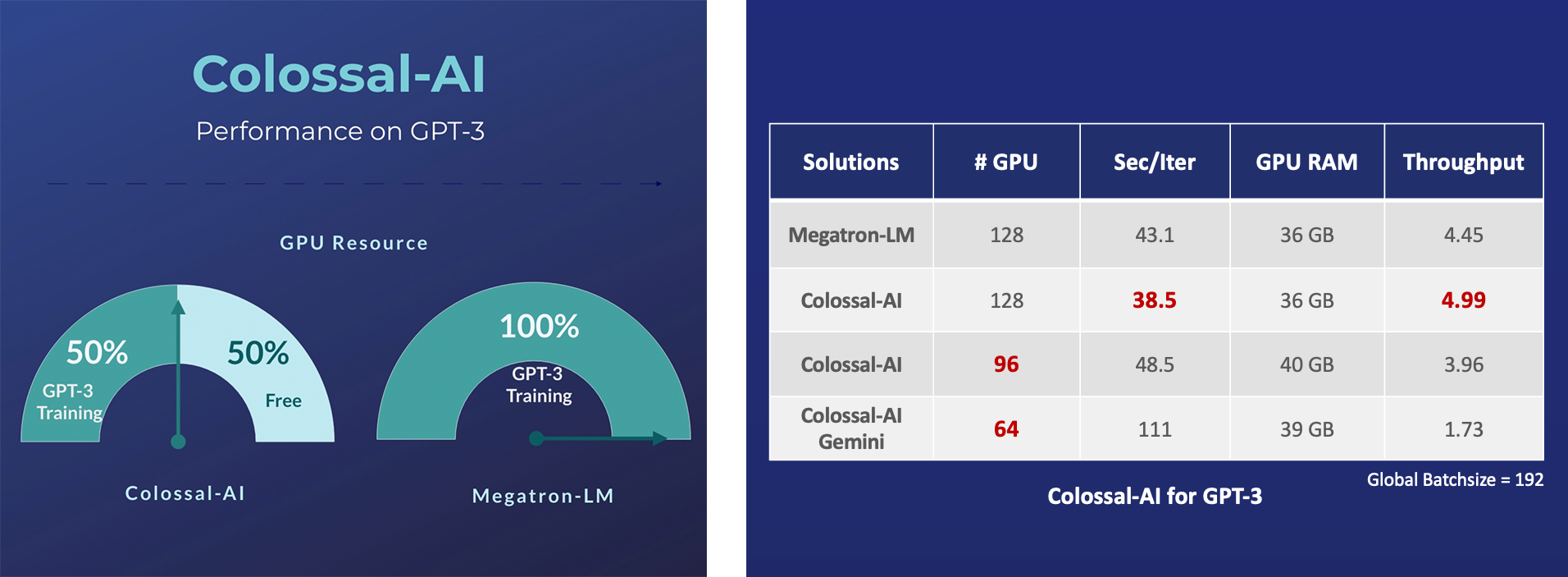

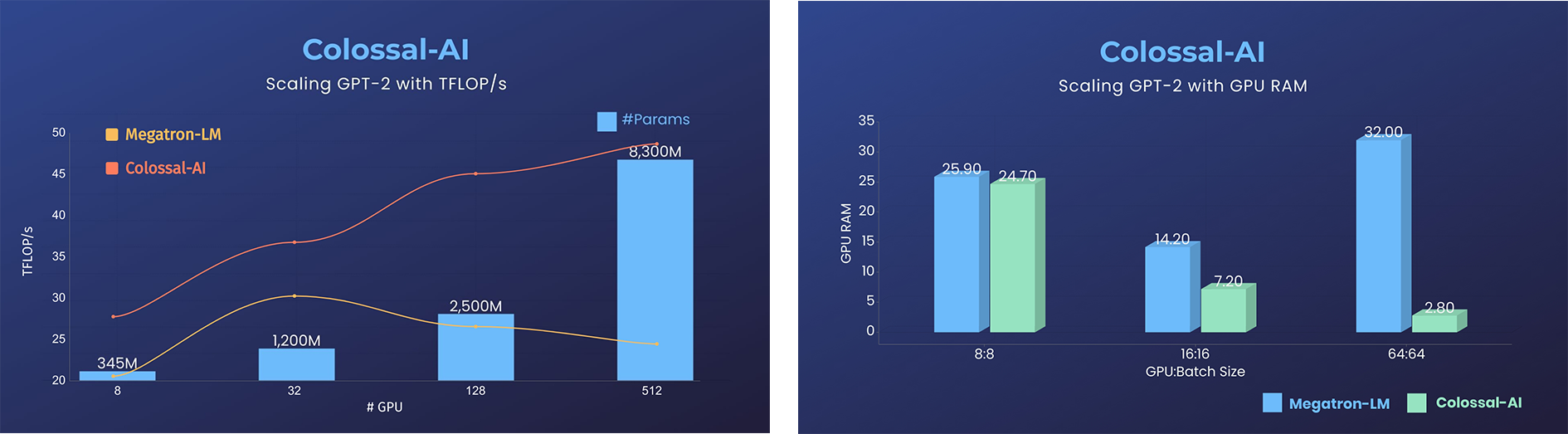

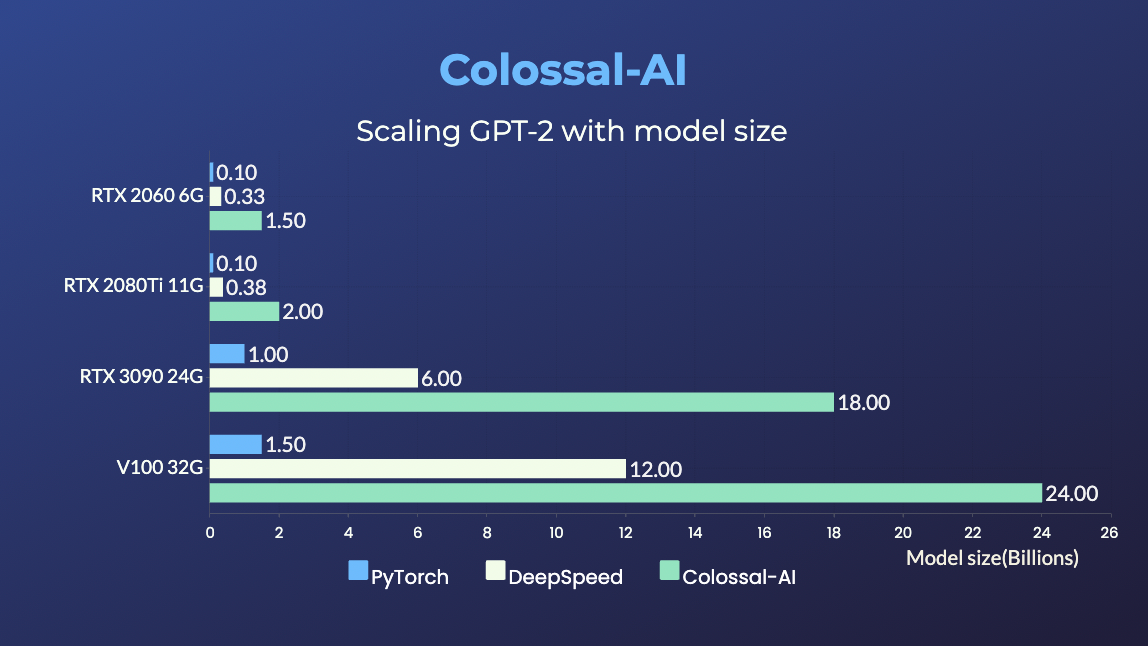

GPT-2.png) - 用相同的硬件训练24倍大的模型

- 超3倍的吞吐量

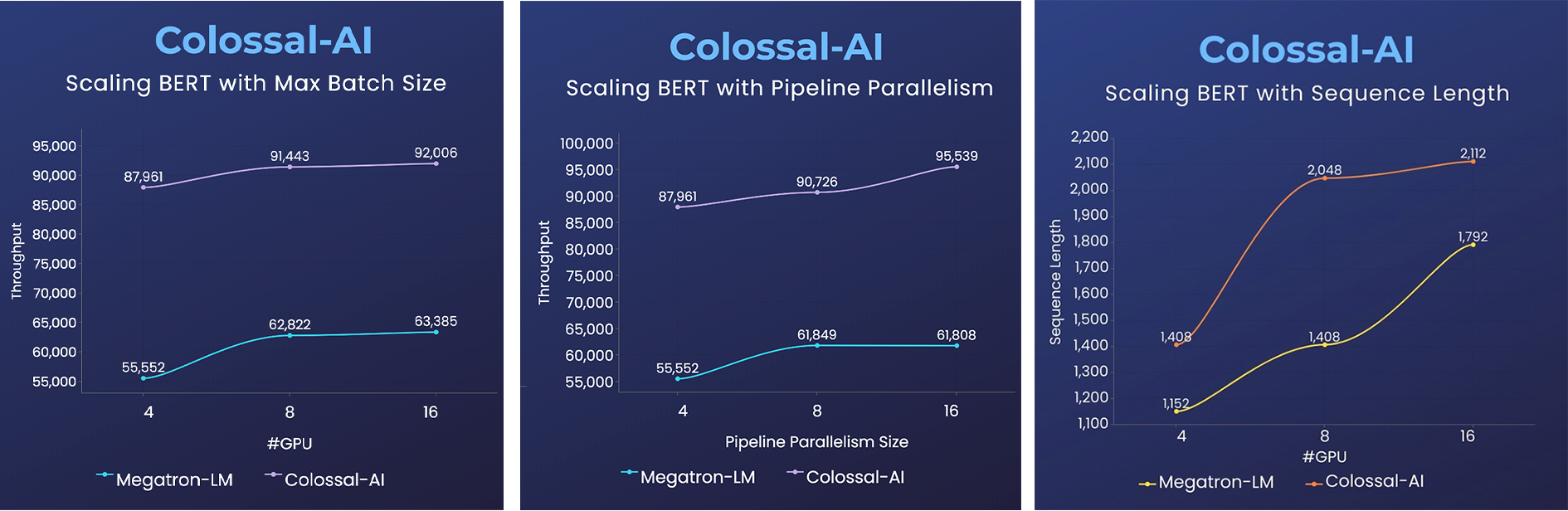

### BERT

- 用相同的硬件训练24倍大的模型

- 超3倍的吞吐量

### BERT

- 2倍训练速度,或1.5倍序列长度

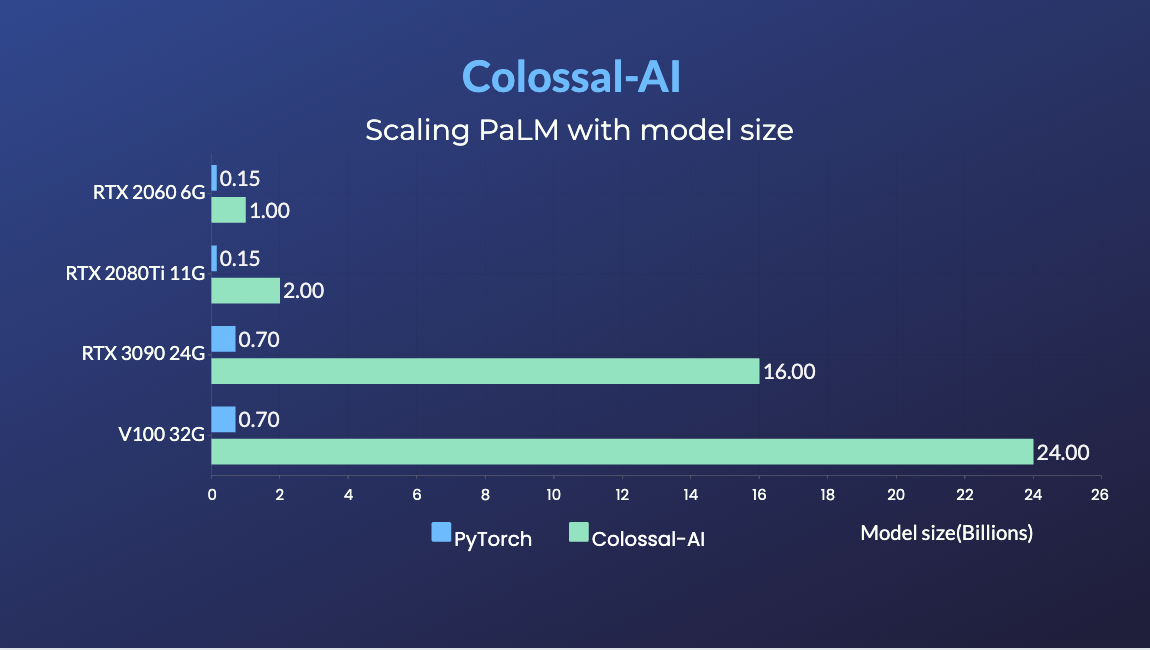

### PaLM

- [PaLM-colossalai](https://github.com/hpcaitech/PaLM-colossalai): 可扩展的谷歌 Pathways Language Model ([PaLM](https://ai.googleblog.com/2022/04/pathways-language-model-palm-scaling-to.html)) 实现。

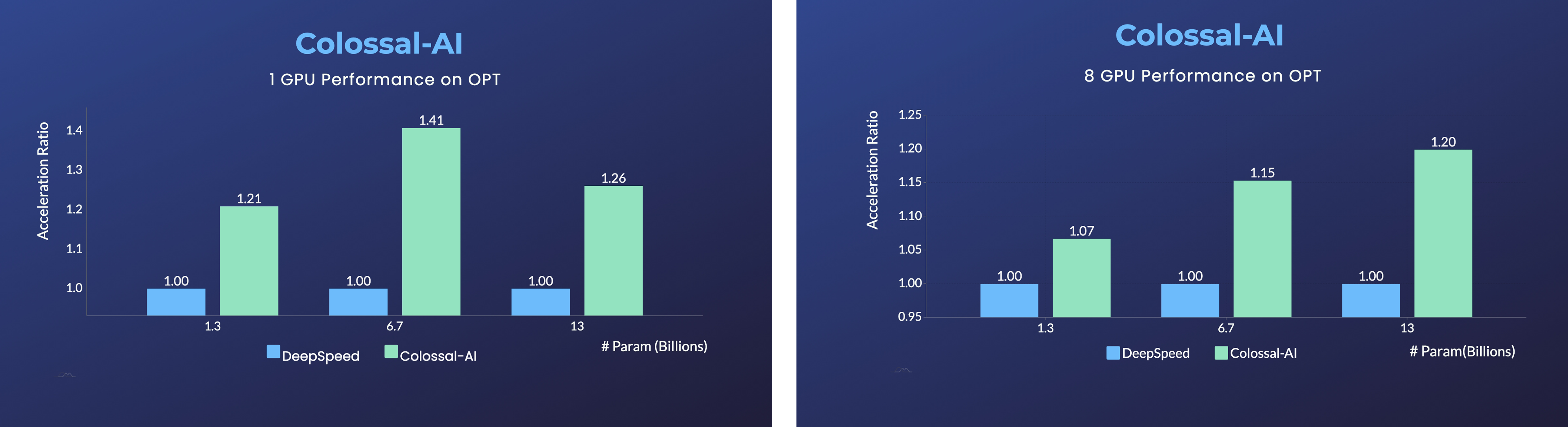

### OPT

- 2倍训练速度,或1.5倍序列长度

### PaLM

- [PaLM-colossalai](https://github.com/hpcaitech/PaLM-colossalai): 可扩展的谷歌 Pathways Language Model ([PaLM](https://ai.googleblog.com/2022/04/pathways-language-model-palm-scaling-to.html)) 实现。

### OPT

- [Open Pretrained Transformer (OPT)](https://github.com/facebookresearch/metaseq), 由Meta发布的1750亿语言模型,由于完全公开了预训练参数权重,因此促进了下游任务和应用部署的发展。

- 加速40%,仅用几行代码以低成本微调OPT。[[样例]](https://github.com/hpcaitech/ColossalAI-Examples/tree/main/language/opt)

请访问我们的 [文档](https://www.colossalai.org/) 和 [例程](https://github.com/hpcaitech/ColossalAI-Examples) 以了解详情。

- [Open Pretrained Transformer (OPT)](https://github.com/facebookresearch/metaseq), 由Meta发布的1750亿语言模型,由于完全公开了预训练参数权重,因此促进了下游任务和应用部署的发展。

- 加速40%,仅用几行代码以低成本微调OPT。[[样例]](https://github.com/hpcaitech/ColossalAI-Examples/tree/main/language/opt)

请访问我们的 [文档](https://www.colossalai.org/) 和 [例程](https://github.com/hpcaitech/ColossalAI-Examples) 以了解详情。

(返回顶端)

## 单GPU训练样例展示 ### GPT-2

(返回顶端)

## 使用 Docker ### 从DockerHub获取镜像 您可以直接从我们的[DockerHub主页](https://hub.docker.com/r/hpcaitech/colossalai)获取最新的镜像,每一次发布我们都会自动上传最新的镜像。 ### 本地构建镜像 运行以下命令从我们提供的 docker 文件中建立 docker 镜像。 > 在Dockerfile里编译Colossal-AI需要有GPU支持,您需要将Nvidia Docker Runtime设置为默认的Runtime。更多信息可以点击[这里](https://stackoverflow.com/questions/59691207/docker-build-with-nvidia-runtime)。 > 我们推荐从[项目主页](https://www.colossalai.org)直接下载Colossal-AI. ```bash cd ColossalAI docker build -t colossalai ./docker ``` 运行以下命令从以交互式启动 docker 镜像. ```bash docker run -ti --gpus all --rm --ipc=host colossalai bash ```(返回顶端)

## 社区 欢迎通过[论坛](https://github.com/hpcaitech/ColossalAI/discussions), [Slack](https://join.slack.com/t/colossalaiworkspace/shared_invite/zt-z7b26eeb-CBp7jouvu~r0~lcFzX832w), 或[微信](https://raw.githubusercontent.com/hpcaitech/public_assets/main/colossalai/img/WeChat.png "qrcode")加入 Colossal-AI 社区,与我们分享你的建议和问题。 ## 做出贡献 欢迎为该项目做出贡献,请参阅[贡献指南](./CONTRIBUTING.md)。 真诚感谢所有贡献者!(返回顶端)

## 快速预览 ### 几行代码开启分布式训练 ```python parallel = dict( pipeline=2, tensor=dict(mode='2.5d', depth = 1, size=4) ) ``` ### 几行代码开启异构训练 ```python zero = dict( model_config=dict( tensor_placement_policy='auto', shard_strategy=TensorShardStrategy(), reuse_fp16_shard=True ), optimizer_config=dict(initial_scale=2**5, gpu_margin_mem_ratio=0.2) ) ```(返回顶端)

## 引用我们 ``` @article{bian2021colossal, title={Colossal-AI: A Unified Deep Learning System For Large-Scale Parallel Training}, author={Bian, Zhengda and Liu, Hongxin and Wang, Boxiang and Huang, Haichen and Li, Yongbin and Wang, Chuanrui and Cui, Fan and You, Yang}, journal={arXiv preprint arXiv:2110.14883}, year={2021} } ```(返回顶端)